رایانش احساسی

رایانش احساسی (که به نام هوش مصنوعی احساسی نیز شناخته میشود)[1] مطالعه و توسعهٔ سیستمها و ابزارهایی است که میتوانند هیجانات انسانی را تشخیص، تفسیر، پردازش و شبیهسازی کنند؛ که یک حوزهٔ بین رشتهای است که علوم کامپیوتر، روانشناسی و علوم شناختی را شامل میشود[2] هرچند ممکن است خاستگاه این علوم به اولین جستجوهای فیلسوفانه در احساسات برگردد[3] این شاخهٔ تازهٔ علوم کامپیوتر با مقالهٔ Rosalind Picard[4]

در سال ۱۹۹۵ در رابطه با رایانش احساسی معرفی شد.

هدف این تحقیقات شبیهسازی انتقال احساسات میباشد. ماشین باید بتواند حالت احساسی انسان را تفسیر کرده، رفتار خود را با آن تطبیق داده، به آن احساسات واکنش مناسب نشان دهد.[5][6]

تفاوت بین آنالیز عواطف (sentiment analysis) و آنالیز احساسات این است که دومی احساسات متفاوت را بعینه تشخیص میدهد نه صرفاً متفاوت بودن هرکدام از آنها را.

حوزهها

یافتن و تشخیص اطلاعات احساسی

کشف اطلاعات احساسی با سنسورهای غیرفعالی آغاز میشود که اطلاعات فیزیکی یا رفتاری کاربر را بدون مداخله در ورودی میگیرند. دادهٔ جمعآوری شده با نشانههایی هایی که انسانها از آنها کمک میگیرند تا احساسات دیگران را درک کنند هم تراز است. برای مثال، یک دوربین ویدئویی ممکن است حالات صورت، بدن و حرکات انسان را ضبط کند در حالی که میکروفون حرفهای گفته شده را ذخیره میکند. سنسورهای دیگر نشانههای احساسی را مستقیماً با اندازهگیری دادههای فیزیولوژیکی مانند دمای بدن و مقاومت هیجان آور(galvanic resistance) پیدا میکنند.[7]

تشخیص اطلاعات احساسی مستلزم آن است که الگوهای معنادار از دادههای جمعآوری شده استخراج شود. این عمل به وسیلهٔ تکنیکهای یادگیری ماشین که انواع دادهها را تفسیر میکنند مانند تشخیص گفتار، پردازش زبان طبیعی یا شناسایی حالات صورت صورت میپذیرد صورت میگیرد. این الگوریتمها یا یک برچسب (مانند سردرگم) تولید کرده یا به یک فضای ارزش گذاری تخصیص داده میشوند.

احساسات در ماشینها

یک حوزهٔ دیگر رایانش احساسی طراحی دستگاههایی است که قادرند تواناییهای حسی ذاتی خود را بروز داده یا میتوانند احساسات را بهطور قانع کننده ای شبیهسازی کنند. یک نگرش کاربردی تر بر اساس تواناییهای تکنولوژیکی حال حاضر، شبیهسازی احساسات در عاملهای مکالمه ای (مثل السای آمازون) برای اثرگذاری هر چه بیشتر ارتباط بین انسانها و ماشینها میباشد.[8]

ماروین منسکی، یکی از پیشگامان علوم کامپیوتر در هوش مصنوعی، از احساسات به عنوان بحث وسیع تری در هوش ماشین نام برده در Emotion Machine بخاطر نشان میکند که: احساس فرق چندانی با روند متفاوتی که ما به عنوان «تفکر» میشناسیم ندارد.[9]

فناوریها

در علوم شناختی و علوم اعصاب، دو مدل اساسی درک و طبقهبندی احساست توسط انسانها را توضیح میدهند: مدل پیوسته (continuous) و مدل قیاسی (categorical). مدل پیوسته هر حالت صورت را به عنوان یک بردار ویژگی در فضای صورت بیان میکند. این مدل برای مثال توضیح میدهد چگونه احساسات با شدتهای مختلف دیده می شونند. در مقابل، مدل قیاسی از طبقهبندی کنندههایی تشکیل شده که هرکدام بر حسب یک دستهٔ عواطف خاص تنظیم شدهاند. این مدل توضیح میدهد چرا عکسهای یک تزریق مورفین بین صورت خوشحال و شگفت زده به عنوان خوشحال یا شگفت زده تفسیر میشوند و نه چیزی بین این دو.

این دو نگرش یک عیب بزرگ مشترک دارند: میتوانند فقط یک نوع حس را از عکس برداشت کنند، این تمام کاری است که این دو روش قادر به انجامش هستند. هرچند با گذشت هر روز می میتوانیم بیش از یک نوع حس از یک عکس برداشت کنیم. هم روش پیوسته و هم قیاسی قادر به شناسایی چندین حس از یک عکس نیستند، پس یک روش جدید مدلسازی در نظر گرفتن یک نوع دستهبندی برای هم پوشانی دستهبندیهای کوچک دیگر است. مطالعه ای مرتبط با این موضوع در «مدلی برای درک حالتهای احساسات صورت انسانها: مرور تحقیقات و نقطه نظرات» به تفصیل آورده شدهاست.[10]

قسمتهای بعدی ویژگیهای احتمالی را مورد توجه قرار میدهند که میتوانند برای تشخیص احساسات به کار گرفته شوند.

احساسات در گفتار

تغییرات گوناگون در سیستم عصبی خودکار میتوانند بهطور غیر مستقیم گفتار انسان را تغییر دهند و تکنولوژیهای حسی میتوانند از این اطلاعات استفاده کرده، احساسات را تشخیص دهند. برای مثال، گفتار ایجاد شده در حالت ترس، عصبانیت یا شادی تند و بلند ادا شده واضحاً زیرتر و گستردهتر به گوش میرسند در حالی که احساساتی همچون خستگی، بی حوصلگی یا ناراحتی بم تر بوده مبهم تر به گوش میرسند.[11] به نظر میرسد بعضی عواطف مانند عصبانیت[12] یا تأیید[13] راحت تر بهطور محاسباتی شناسایی میشوند.

تکنولوژیهای پردازش احساسی گفتار حالت احساسی کاربر را با استفاده از آنالیز محاسباتی ویژگیهای کلامی تشخیص میدهند. پارامترهای گفتاری و ویژگیهای عروضی مانند متغیرهای زیر و بمی صدا و سرعت گفتار میتوانند به وسیلهٔ تکنیکهای تشخیص الگو آنالیز شوند.[12][14]

آّنالیز گفتار یک روش کارا برای شناسایی حالت حسی با دقت گزارش ۷۰تا ۸۰٪ در مطالعات اخیر میباشند.[15][16] این سیستمها بهطور متوسط از انسانها (با دقت تقریبی ۶۰٪) بهتر عمل میکنند اما دقتشان از سیستمهایی که از روشهای دیگر مانند حالت فیزیولوژیکی یا حالات صورت برای تشخیص احساسات استفاده میکنند، کمتر است.[17] بهرچند، از آنجایی که بسیاری از مشخصات گفتاری مستقل از معنا یا فرهنگ هستند، این تکنیک روشی امیدبخش برای تحقیقات آتی قلمداد میشود.[17]

الگوریتمها

فرایند تشخیص احساست در گفتار/ نوشتار نیازمند ایجاد پایگاه داده، دانش یا مدل فضای برداری قابل اطمینان میباشد.[18] که به اندازهٔ کافی گسترده بوده تا تمامی نیازهای کاربردی آن را برطرف کند و همچنین به تعدادی طبقهبندی کنندهٔ موفق نیاز است که اجازهٔ دستهبندی سریع و دقیق را بدهد.

در حال حاضر، بیشتر روشهای طبقهبندی استفاده شده طبقهبندی کنندههای تفکیک کنندهٔ خطی (LDC) ,

k امین همسایهٔ نزدیک (K-NN)، مدل گوسین ترکیبی (GMM)، ماشین بردار پشتیبان (SVM)، شبکههای عصبی مصنوعی (ANN)، الگوریتمهای درخت انتخابگر و مدلهای مارکوف پنهان میباشند.[19] تحقیقات بسیاری نشان میدهند بهطور کلی انتخاب طبقهبندی کنندهٔ مناسب بهطور چشمگیری عملکرد سیستم را افزایش میدهد.[17] لیست زیر توضیح کوتاهی از هر الگوریتم ارائه میدهد:

- LDC - بر اساس مقدار استخراج شده از ترکیب خطی مقدارهای آینده تعیین میشود، که معمولاً به صورت برداری از ویژگیها به دست میآید.

- k-NN - بر اساس جایگذاری شی در فضای آینده و مقایسهٔ ان با k امین همسایهٔ نزدیک (دادههای آموزش) به دست میآید. جایگاه اکثریت، طبقهبندی را تعیین میکند.

- GMM - مدلی احتمالاتی برای نشان دادن وجود زیر مجموعه ای از جمعیت کلی است. هر زیر مجموعه با استفاده از توزیع ترکیبی توصیف شده، به طبقهبندی کنندههای مشاهده گر اجازهٔ ورود به زیر مجموعهٔ جمعیت کلی میدهد.[20]

- SVM - نوعی (معمولاً باینری) از طبقهبندی کنندههای خطی است که تصمیم میگیرد هر ورودی در کدامیک از دو طبقهبندی (یا بیشتر) ممکن جای بگیرد.

- ANN - مدلی ریاضی، الهام گرفته از شبکههای عصبی زیستی است که میتواند خواص غیر خطی فضای آینده را بهتر در بر بگیرد.

- الگوریتم درخت تصمیمگیری - بر اساس دنبال کردن درخت انتخابی کار میکند که برگهایش نمایانگر خروجی طبقهبندی کننده بوده و شاخههایش نشانگر پیوستگی توالیهای ویژگیهایی است که به طبقهبندی منجر میشوند.

- HMMs - یک مدل مارکف آماری که در آن حالتها و انتقال حالتها بهطور مستقیم قابل مشاهده نیست. در عوض، سریهای خروجی که وابسته به حالتها هستند، قابل مشاهده است. در مورد تشخیص اثر، خروجیها نشان دهنده توالی از بردارهای ویژگی گفتاری است، که اجازه کسر توالی حالتها که از طریق آن مدل پیشرفت کرده را میدهد. حالتها میتوانند گامهای میانجی گوناگونی را در بیان یک احساس تشکیل دهند و هر کدام از آنها یک توزیع احتمال در روی بردارهای خروجی ممکن داشته باشند. توالی حالتها به ما امکان میدهد تا حالت احساسی که ما در حال تلاش برای طبقهبندی آن هستیم پیشبینی کنیم، و این یکی از رایجترین تکنیکهای استفاده شده در حوزه گفتار مبتنی بر تشخیص است.

ثابت شدهاست که داشتن شواهد صوتی کافی در دسترس وضعیت احساسی یک فرد میتواند با مجموعه ای از اکثریت شرکت کننده در ردهبندی، طبقهبندی شود.

مجموعه پیشنهاد شده طبقهبندی کنندهها بر پایه این سه طبقهبندی کننده اصلی است:

kNN , C4.5 و SVM-RBF Kernel(ترکیب ماشین بردار پشتیبان با هسته تابع پایه شعاعی).

این مقایسه با دو مجموعه دیگر طبقهبندی کننده انجام شدهاست: روش یکی در مقابل همهٔ (OAA) و ماشین بردار پشتیبان (SVM) چند منظوره با هستههای ترکیبی و یکی روش مجموعه ای از طبقهبندیها که شامل دو طبقهبندی کننده اصلی است: روش C5.0 و شبکه عصبی.

نوع دیگر پیشنهاد شده عملکرد بهتری را نسبت به دو مجموعه طبقهبندی کننده دیگر به دست میآورد.[21]

پایگاههای داده

اکثریت عظیم سیستمهای فعلی، وابسته به داده هستند. این باعث یکی از بزرگترین چالشها در تشخیص احساسات مبتنی بر گفتار میشود، همانطور که دلالت دارد انتخاب یک پایگاه داده مناسب برای آموزش طبقهبندی کننده استفاده شدهاست. اکثر اطلاعات موجود در حال حاضر از بازیگران به دست آمدهاست و بنابراین نمایشی از احساسات (emotions)نمونه اولیه است.

آن به اصطلاح مجموعه دادههای بازی شده، معمولاً بر پایه نظریه احساسات اصلی است (که توسط پل اکمن ارایه شد)،

که وجود شش احساس اصلی را شامل میشود (خشم، ترس، انزجار، تعجب، شادی، غم و اندوه)، و دیگر احساسات به صورت یک ترکیب از آنها است.[22] با این اوصاف، هنوز هم اینها کیفیت صوتی بالا و کلاسهای متعادل را پیشنهاد میدهند (گرچه اغلب خیلی کم هستند)، که به افزایش میزان موفقیت در شناخت احساسات کمک میکند.

با این حال، برای کاربرد زندگی واقعی، دادههای طبیعی ترجیح داده میشود. یک پایگاه داده طبیعی میتواند با مشاهده و تجزیه و تحلیل افراد در زمینههای طبیعی آنها تولید شود.

در نهایت، چنین پایگاه دادهای باید به سیستم اجازه دهد تا احساسات را براساس زمینه آنها تشخیص دهد و همچنین اهداف و پیامدهای تعامل را تعبیه کند.

طبیعت این نوع داده، اجازه میدهد تا برای اجرای صحیح زندگی واقعی با توجه به این واقعیت، حالتهایی که بهطور طبیعی در طول تعامل انسان و کامپیوتر (HCI) رخ میدهد را توصیف میکند.

علیرغم مزایای فراوانی که دادههای طبیعی بر دادههای بازی شده دارد، بدست آوردن آن دشوار است و معمولاً دارای شدت احساسی کم است. علاوه بر این، دادههای به دست آمده در زمینه طبیعی به دلیل سر و صدا محیط اطراف و فاصله افراد از میکروفون دارای کیفیت سیگنال پایین است.

اولین تلاش برای تولید چنین پایگاه دادهای، کپسول احساس FAU Aibo بود که برای CEICES (ترکیبی از تلاشها برای بهبود طبقهبندی خودکار حالتهای احساسی کاربر) براساس یک زمینه واقع بینانه از کودکان (سن ۱۰ تا ۱۳ سالگی) که با ربات حیوان خانگی Aibo سونی بازی میکنند، بود.

به همین ترتیب، تهیه یک پایگاه داده استاندارد برای همه تحقیقات احساسی، یک روش ارزیابی و مقایسه تأثیر سیستمهای تشخیص را فراهم میکند.[19][23]

توصیفگرهای گفتار

پیچیدگی روند شناخت تأثیر، با تعداد کلاسها (تأثیرات) و توصیفگرهای گفتاری مورد استفاده در طبقهبندی افزایش میابد؛ بنابراین، حیاتی است که فقط مرتبطترین ویژگیها را انتخاب کنید تا از توانایی مدل برای شناسایی احساسات همراه با افزایش کارایی، که بهطور خاص برای تشخیص در زمان واقعی معنی دار است، اطمینان حاصل شود.[19] طبق برخی مطالعات که به استفادهٔ بیش از ۲۰۰ ویژگی مجزا اشاره میکند، نشان میدهد که دامنه انتخابهای ممکن گستردهاست. برای بهینهسازی سیستم و افزایش میزان موفقیت تشخیص صحیح احساسات، شناسایی آنهایی که زاید و نامطلوب هستند، بسیار مهم و حیاتی است.[19][23] ۱. ویژگیهای فرکانس - شکل تلفظ : تحت تأثیر نرخ تغییر فرکانس اساسی قرار میگیرد.

- میانگین زیر و بمی صدا: توصیف چگونگی بالا یا پایینی گوینده نسبت به گفتار عادی که صحبت میکند.

- شیب حدفاصل: گرایش تغییر فرکانس را در طول زمان توصیف میکند، میتواند بالا رونده، پایین رونده یا تراز باشد.

- کاهش نهایی: مقداری که توسط آن فرکانس در پایان یک صحبت میافتد.

- دامنه زیرو بمی صدا: اندازه گسترش بین حداکثر و حداقل فرکانس یک سخنرانی است.

۲. ویژگیهای مرتبط با زمان

- نرخ گفتار : میزان لغات یا هجاهایی را که در طول یک واحد زمان بیان میشود، توصیف میکند.

- فرکانس تأکید: میزان وقوع زیر و بمی تأکید شده سخنان را اندازهگیری میکند.

۳. پارامترهای کیفیت صدا و توصیفگرهای انرژی:

- تنفس : صدای تنفس را در گفتار اندازهگیری میکند.

-درخشندگی : غلبه فرکانس بالا یا پایین را در صحبت توصیف میکند.

-بلندی صدا: دامنه شکل موج صحبت یا به نحوی انرژی صحبت را اندازهگیری میکند.

-ناپیوستگی مکث: گذار بین صدا و سکوت را توصیف میکند.

-ناپیوستگی زیر وبمی صدا: گذار از فرکانس اساسی را توصیف میکند.

شناسایی اثرات چهره

تشخیص و پردازش بیان صورت توسط روشهای مختلفی از قبیل جریان نوری، مدلهای پنهان مارکوف، پردازش شبکه عصبی یا مدلهای ظاهر فعال به دست میآید. بیش از یک روش میتواند ترکیبی یا همجوشی باشد (تشخیص چندجملهای، مثلاً چهرهها و گفتارهای سخنرانی،[2] صورتها و حرکات دست،[24] یا بیان صورت با گفتار و متن برای تجزیه و تحلیل دادهها و تجزیه و تحلیل متادیتای چندجمله ای) برآورد قوی وضعیت عاطفی موضوع.

پایگاه دادههای حالت چهره

ایجاد پایگاه داده احساسات یک کار دشوار و وقت گیر است. با این حال، ایجاد پایگاه داده یک گام ضروری در ایجاد یک سیستم است که احساسات انسان را تشخیص میدهد. اکثر پایگاه دادههای احساسی در دسترس عموم فقط حالات چهره ژست گرفته شده را شامل میشود.

در پایگاه دادههای حالات ژست گرفته شده، از شرکت کنندگان خواسته میشود تا حالات احساسی پایه مختلف را نمایش دهند، در حالی که در پایگاه دادههای خودجوش حالات طبیعی هستند. تحریک احساسات خودجوش مستلزم تلاش قابل توجه در انتخاب محرکهای مناسب است که میتواند منجر به نمایش غنی از احساسات مورد نظر شود. در مرحله دوم، این فرایند شامل نشانه گذاری احساسات توسط افراد آموزش دیده به صورت دستی است که پایگاههای داده را بسیار قابل اعتماد میسازد. چون که ادراک حالات و شدت آنها در واقع پیرو نظر شخصی است، حاشیه نویسی و تفسیر آنها توسط متخصصین برای داشتن اعتبار امری ضروری است.

محققان با سه نوع پایگاه داده کار میکنند، مانند یک پایگاه داده از اوج حالت تصاویر، یک پایگاه داده از توالیهای تصویر که تصویرگر یک احساس از حالت خنثی تا اوج آن است و کلیپهای ویدئویی با حاشیه نویسیهای احساسی. بسیاری از پایگاه دادههای حالت چهره صورت گرفتهاند و برای هدف شناسایی حالات شناخته شده ساخته شدهاند. دو پایگاه داده که بهطور گستردهای استفاده میشود CK + و JAFFE هستند.

دستهبندی احساس

با انجام تحقیق میان فرهنگهای متفاوت در پاپوآ گینه نو بر روی افراد قبایل پیشین در اواخر دهه ۱۹۶۰، پل اکمن این ایده را که حالت چهره ناشی از احساس توسط فرهنگ تعیین نشده و جهانی هستند را مطرح کرد. بر این اساس او پیشنهاد داد که منشأ این حالات بیولوژیکی بوده و بنابراین میتوانند به صورت مطمئن و صحیح دستهبندی شوند. به همین علت او به صورت رسمی شش احساس پایه ای را در سال ۱۹۷۲ ارائه کرد:[2][22]

با این حال در دهه ۱۹۹۰، اکمن لیست احساسات پایه ای خود را توسعه داد و محدوده ای از احساسات مثبت و منفی را به لیست اولیه اضافه کرد که الزاماً همه محدود به ماهیچههای صورت نبودند. این احساسات جدیداً اضافه شده عبارتند از:[25]

سیستم کد کردن حرکت صورت

با تعریف کردن حالات بر اساس اعمال ماهیچهها، سیستمی طراحی شدهاست تا به صورت رسمی نمود فیزیکی احساسات را دستهبندی کند. مفهوم مرکزی سیستم کد کردن حرکت صورت یا FACS که در سال ۱۹۷۸ توسط پاول اکمن و والس و. فریسن ایجاد شدهاست، واحدهای عمل (Action Unit) هستند. آنها اساساً یک منقبض شدن یا نشدن یک یا تعداد بیشتری ماهیچه هستند. اما هر چقدر هم که این مفهوم ساده به نظر برسد، برای شکلدادن پایهٔ یک سیستم شناسایی احساسی پیچیده و عاری از تفسیر کافیست.[26]

با تشخیص سرنخهای مختلف در حالات صورت، دانشمندان قادرند که رابطهٔ هر یک از آنها را به کد واحد عمل مربوطه اش برقرار سازند. در نتیجه، آنها دستهبندی زیر را از شش احساس پایه بر اساس واحدهای عملشان ارائه کردهاند. (در اینجا علامت "+" به معنای "و" است)

| احساسات | عمل واحد |

|---|---|

| شادی | ۶+۱۲ |

| غم و اندوه | ۱+۴+۱۵ |

| تعجب | 1+2+5B+۲۶ |

| ترس | ۱+۲+۴+۵+۲۰+۲۶ |

| خشم | ۴+۵+۷+۲۳ |

| انزجار | ۹+۱۵+۱۶ |

| تحقیر | R12A+R14A |

چالشها در تشخیص حالت چهره

درست مثل هر کار محاسباتی دیگر، در تشخیص احساس با پردازش حالت چهره موانعی وجود دارند که باید از میان برداشته شوند تا بهطور کامل از پتانسیل پنهان الگوریتم کلی یا متد به کار گرفته شده استفاده شود. دقت مدلسازی و ردیابی، به خصوص در مراحل اولیه محاسبات احساسی یک مشکل بود. با تکامل سختافزار، با کشفیات جدید و معرفی تلاشهای جدید، این مسئله فقدان دقت حل میشود، بدون در نظر گرفتن مشکلات نویز. اما برای رفع نویز راهکارهای مختلفی از جمله میانگینگیری همسایگی neighborhood averaging، هموار کردن به کمک گوسین خطی linear Gaussian smoothing، فیلتر میانه[27] یا راهکارهای جدیدتری مثل الگوریتم بهینهسازی جستجوی تغذیه باکتریایی Bacterial Foraging Optimization وجود دارند.[28][29][30]

آاین که درجه دقت در تشخیص چهره (نه تشخیص حالت احساس) به دقت بالای کافی برای آن که اجازه استفاده مؤثر گسترده آن را در سطح جهانی بدهد، نرسیدهاست، به صورت عمومی شناخته شدهاست (تلاشهای زیادی در این زمینه، به ویژه از طرف نهادهای اجرای قانون، صورت گرفتهاست که در موفقیت شناسایی مجرمان، شکست خوردند). بدون بهبود بخشیدن دقت سختافزار و نرمافزار استفاده شده برای تشخیص چهره، سرعت پیشرفت کار به شدت کند میشود.

چالشهای دیگر عبارتند از:

- این حقیقت که حالات ژست گرفته شده توسط اکثر اشخاص در مطالعات گوناگون، طبیعی نبوده و در نتیجه ۱۰۰ درصد دقیق نیستند.

- فقدان آزادی حرکت دورانی. تشخیص احساس برای عکسی که مستقیم و از روبرو گرفته شده باشد خیلی خوب کار میکند، ولی به محض چرخش بیش از ۲۰ درجه سر، «مشکلاتی وجود دارد.»[31]

ژست بدن

ژستها میتوانند به صورت مؤثر به عنوان وسیله ای برای تشخیص یک حالت احساسی خاص از بکار برنده آن استفاده شوند، به ویژه زمانی که در ترکیب با تشخیص چهره و تشخیص و گفتار استفاده میشنود. بسته به عمل خاص، ژستها میتوانند پاسخهای واکنشی ساده ای باشد، مثل بالا انداختن شانهها هنگامی که پاسخ یک سؤال را نمیدانید، یا میتوانند پیچیده و پر معنا باشند، مثل ارتباط برقرار کردن با زبان اشاره. بدون استفاده از هیچ شی یا محیط اطرافمان، میتوانیم دستهایمان تکان دهیم، دست بزنیم یا به کسی اشاره کنیم که به سمتمان بیاید. از طرف دیگر، هنگام استفاده از اشیا میتوانیم به آنها اشاره کنیم، حرکتشان بدهیم، لمسشان کنیم یا حملشان کنیم. یک کامپیوتر باید توانایی تشخیص این اعمال، تحلیل موقعیت و پاسخگویی معنادار را داشته باشد تا برای تعامل انسان-کامپیوتر به صورت مؤثر استفاده شود.

روشهای زیادی برای تشخیص ژست بدن پیشنهاد شدهاست.[32] برخی از مقالات ۲ رویکرد متفاوت در تشخیص ژست را متمایز کردهاند: یکی بر اساس یک مدل ۳ بعدی و دیگری براساس ظاهر[33] روش اول از اطلاعات سه بعدی از المانهای کلیدی اعضای بدن استفاده میکند تا چندین پارامتر مهم بدست بیاورد، مثل موقعیت کف دست یا زاویه مفاصل. از طرف دیگر، سیستمهای مبتنی بر ظاهر از تصاویر و ویدیوها برای تفسیر مستقیم استفاده میکنند. ژست دستها یک نقطه تمرکز معمول در روشهای تشخیص ژست بدن است.

نظارت فیزیولوژیکی

نظارتهای فیزیولوژیکی میتوانند جهت تشخیص حالت احساسی یک کاربر با استفاده از نظارت و تحلیل نشانههای فیزیلوژیکی او استفاده شود. این نشانهها از پالس و ضربان قلب آنها تا انقباضات دقیقه ای عضلات صورت تغییر میکند. این زمینه تحقیقاتی همچنان در مراحل نسبتاً ابتدایی است چرا که به نظر میرسد تمایل بیشتری به سمت تشخیص احساس از طریق دادههای ورودی صورت وجود دارد. با وجود این، این زمینه در حال شتاب گرفتن است و در حال حاضر شاهد محصولاتی واقعی هستیم که تکنیکها را پیداه سازی میکنند. سه نشانه اصلی فیزیولوژیکی که میتوانند مورد تحلیل قرار بگیرند عبارتند از:

ضربان حجم خون، پاسخ گالوانیک پوست و الکترومیوگرافی صورت.

مرور کلی

ضربان حجم خون (BVP) یک فرد میتواند توسط فرایندی که فوتوپلسیسموگرافی نامیده میشود، اندازهگیری شود، که گرافی که نشان دهنده جریان خون در اندامها است را ایجاد میکند. قلههای موجها یک سیکل قلبی را که قلب، خون را به اندامها پمپاژ کردهاست را نشان میدهند.[34] اگر فرد دچار ترس شود یا غافلگیر شود، قلبش معمولاً «میپرد» و برای مدتی تندتر میزند که باعث میشود دامنه سیکل قلبی افزایش پیدا کند. این مسئله به وضوح در فوتوپلسیسموگرافی هنگامی که فاصله بین قعر و قله موج کاهش پیدا کردهاست، قابل مشاهده است. با آرام شدن فرد و گسترش هسته میانی بدن، اجازه میدهد تا خون بیشتری به اندامها جاری شود و دوره به حالت عادی خودش بر میگردد.

روشهای مورد استفاده

اشعه مادون قرمز توسط سختافزار سنسور مخصوصی به پوست تابانده میشود و میزان نور بازتاب شده اندازهگیری میشود. میزان نور بازتابی و منتقل شده با BVR مرتبط است چرا که نور توسط هموگلوبین که به فراوانی در جریان خون وجود دارد جذب میشود.

کاستیها

اطمینان یافتن از این که سنسور تابش نور مادون قرمز و نظاره کردن نور بازتابی همواره به اندام پیشین اشاره میکند، کار دشواری است، به ویژه این که افراد معمولاً در هنگام کار با کامپیوتر خود را کش میدهند و مجدداً موقعیت خود را تنظیم میکنند. فاکتورهای دیگری هم وجود دارند که میتوانند روی ضربان حجم خون یک فرد تأثیر بگذارند. با توجه به این که این کار اندازهگیری جریان خون از میان اندامها است، اگر فرد احساس گرما یا سرمای شدیدی کند، پس بدنش ممکن است اجازه جاری شدن خون بیشتر یا کمتری را از اندامها بدهد که همهٔ این مسائل ارتباطی به حالت احساسی او ندارد.

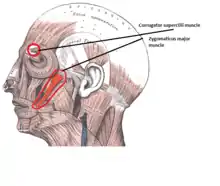

الکترومیوگرافی چهره

الکترومیوگرافی چهره، تکنیکی برای اندازهگیری فعالیت الکتریکی عضلات چهره است؛ که بوسیله ضربههای الکتریکی کوچکی که به وسیله عضلات چهره در زمان برخورد تولید میشوند، تقویت میشوند.[35]

چهره مقدار زیادی احساس را بیان میکند اما دو گروه اساسی از عضله صورت هستند که برای تشخیص احساس مطالعه میشوند: ماهیچه ابرقهرمان موج دار که همچنین به عنوان عضله سرگردان شناخته میشود، باعث اخم ابرو میشود و بنابراین بهترین آزمایش برای واکنش به احساس منفی و نامطبوع است. ماهیچه مهم زیگومتیکاس وظیفه آن، کشیدن گوشههای لب به عقب، موقع خندیدن است و بنابراین عضله ایست که به احساس مثبت واکنش نشان میدهد.

واکنش گالوانیک پوست

پاسخ گالوانیک پوست، یک ابزار هدایت پوست است که وابسته به رطوبت پوست است. در حالیکه غدد عرق این رطوبت را تولید میکنند، خود غدد عرق نیز توسط سیستم عصبی بدن کنترل میشوند. اینجا یک همبستگی بین پاسخ گالوانیک پوست و حالت برانگیختگی بدن وجود دارد، هر چقدر برانگیختگی بیشتر باشد، هدایت پوستی بیشتر است و پاسخ گالوانیک پوست نیز بیشتر میشود.[34]

این میتواند به وسیله دو الکترود کوچک نقره کلرید اندازهگیری شود، بگونه ای که روی پوست قرار میگیرند، در حالی که یک ولتاژ کمی بین آنها است. یک سنسور نیز، هدایت را اندازهگیری میکند. برای ماکزیمم کردن آرامش و کاهش تحریک، الکترودها روی پاها جاسازی شوند که باعث میشود دستها کاملاً راحت بین صفحه کلید و ماوس در ارتباط باشند.

زیباییشناسی بصری

زیباییشناسی در دنیای هنر و عکاسی، اشاره به شناخت اصول طبیعی در خوشایندی از زیبایی دارد. قضاوت در مورد زیبایی و کیفیتهای زیباییشناسی، یک کار ذهنی سطح بالا است. دانشمندان علوم کامپیوتر در دانشگاه پن استیت، بهطور اتوماتیک کیفیت استنتاج کیفیت زیبایی تصاویر رابر اساس محتوای بصری شان، به صورت یک مسئله یادگیری ماشین بررسی میکنند که در آن از تصاویر آنلاین هم مرتبه از یک پایگاه داده تصاویر، استفاده میشد[36] آنها ویژگیهای بصری مشخصی را استخراج میکنند که بر اساس آنها بهطور مفهومی میتوانند بین تصاویر خوشایند و ناخوشایند بر اساس علم زیباییشناسی، تمایز قایل شوند.

کاربردهای بالقوه

آموزش

در کاربردهای آموزش الکترونیکی، از رایانش احساسی برای نشان دادن نمونه ای از معلم کامپیوتری استفاده میشود، موقعی که یک یادگیرنده بی حوصله است یا علاقهمند یا ناامید یا خوشحال است.[37][38]

مراقبتهای بهداشتی

دانش احساسی به کار گرفته شده در رباتهای اجتماعی و همچنین تعداد زیادی از رباتهای پیشرفته در مراقبتهای بهداشتی، منفعت زیادی دارد. زیرا آنها میتوانند حالتهای احساسی کاربران و بیمارانشان را بهتر قضاوت کنند و عملکرد و برنامهریزی را بهطور اختصاصی تری تغییر بدهند. این به ویژه مهم است در کشورهایی که با رشد جمعیت کهنسال و کمبود کارگران جوان، برای پاسخ به نیازهایشان، مواجه میشوند.

رایانش احساسی همچنان برای توسعه تکنولوژی ارتباطات برای افرادی که اوتیسم دارند، در حال اجرا است. قسمت مورد توجه آزمایش در توسعه اینترنت عاطفی یا احساسی نقش دارد.[39][40][41]

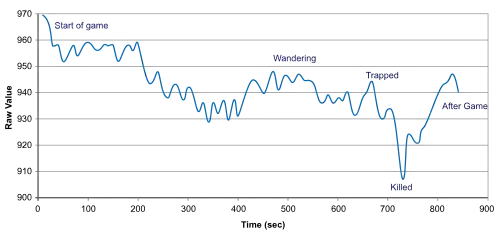

بازیهای ویدئویی

بازیهای ویدیویی تأثیرگذار، حالتهای احساسی بازیکنان را از طریق دستگاههای ثبت بازخورد زنده، ثبت میکنند.

یک فرم بخصوص از بازخورد زنده، از طریق گیم پد است که با فشاردادن یک دکمه، فشار را اندازه میگیرد که این همبستگی زیادی با سطح برانگیختگی بازیکن دارد که به وسیله رابطهای مغز و رایانه در انتهای دیگر مقیاس نشان داده شدهاست. بازیهای تأثیر گذار در تحقیقات پزشکی برای حمایت از توسعه احساسی بچههای اوتیسم به کار گرفته شدهاند.[2][2][42][43]

کاربردهای دیگر

کاربردهای بالقوه دیگر، بر نظارت اجتماعی متمرکز شدهاند. برای مثال یک ما شین میتواند احساس تمام مسافران را برای داشتن ایمنی بیشترتر کنترل کند. مثلاً اگر ماشین تشخیص دهد راننده عصبانی است، وسایل نقلیه را تغییر میدهد.[44] رایانش احساسی کاربردهای دیگری در تعامل انسان و کامپیوتر دارد. به عنوان مثال آینههای احساسی به کاربر اجازه میدهد که عملکرد خودش را ببیند. عوامل کنترل احساسات، قبل از اینکه یک نفر یک ایمیل خشم آلود بفرستد یا حتی دستگاه، موسیقی را با همان حالت پخش کند هشدار میدهد.[45]

یمحقق رومانیایی Dr. Nicu Sebe یک قدم فراتر رفته و آنالیز صورت شخص هنگام استفاده از یک محصول ویژه (به عنوان مثال، یک بستنی) را نشان دادهاست. شرکتها قادرند از این آنالیز برای نتیجهگیری در مورد اینکه آیا این محصول توانسته بازار مربوطه را به دست آورد یا خیر، استفاده کنند.[46]

همچنین از حالت احساسی یک شخص میتوان برای تاثیرپذیری از آگهی تلویزیون در طول ضبط یک ویدیو واقعی در طول آزمایش، استفاده کرد.

میانگین نتایج انجام شده روی یک گروه بزرگ از افراد نشان میدهد که یک نفر میتواند آیا بگوید این آگهی یا فیلم اثر مطلوب داشتهاست و اینکه عواملی که بیشترین علاقه را در تماشاگر ایجاد میکنند را تعیین کند.

رویکرد شناختی در برابر رویکرد تعاملی

در حوزه تعامل انسان و کامپیوتر، مفهوم مدل شناختی یا مدل اطلاعاتی یا مدل احساسی Rosalind Picard's مورد انتقاد شدید واقع شده و با رویکرد پس شناختی یا رویکرد عمل گرا ی تقابلی به کار گرفته شده بوسیله Kirsten Boehner و دیگرانی که احساس را یک مفهوم ذاتاً اجتماعی نشان میدهند، در تقابل است.[47]

توجه پیکارد (Picard's focus) بر تعامل انسان و کامپیوتر است و هدفش برای رایانش احساسی، دادن ظرفیتی به کامپیوتر برای تشخیص، بیان و در برخی حالتها احساس داشتن است. برعکس، رویکرد تعاملی به جست و جوی کمک به مردم برای فهمیدن و تجربه کردن احساساتشان، و توسعه ارتباطات بین فردی وابسته به کامپیوتر است. آن ضرورتاً جستجوی یک نقشه احساس با یک مدل ریاضی واقعی برای تفسیر توسط ماشین نیست اما بهطور نسبی به انسانها اجازه میدهد که احساس را از عبارات احساسی یکدیگر به وسیله روشهای نامحدود مبهم، ذهنی یا حساس به متن، را درک کنند.

منتقدین پیکارد مفهوم احساس او را به عنوان یک مفهوم عینی، بسته، شخصی و ساختاریافته تلقی میکنند. آنها میگویند که حذف مفهوم پیچیدگی از تجربه احساسی، احساس را به یک علامت روانشناختی گسسته کاهش میدهد که داخل بدن اتفاق میافتد و قابل اندازهگیری است و اینکه یک علامت نیز برای شناخت است.[48]

رویکرد معکوس ادعا میکند که اگرچه احساس جنبه بیوفیزیکی دارد، اما "از نظر فرهنگی به طور پویا تجربه شدهاست؛ و تا حدودی بر اساس عمل و عکس العمل ساخته شدهاست. "

از طرف دیگر، احساس را به عنوان «یک محصول فرهنگی و اجتماعی که از درون تجربه میشود»، در نظر میگیرد.[48][49][50]

جستارهای وابسته

- Affective design

- Affective haptics

- Chatterbot

- CyberEmotions

- Emotion Markup Language (EmotionML)

- Kismet (robot)

- Multimodal sentiment analysis

- Sentiment analysis

- Wearable computer

منابع

- Rana el Kaliouby (Nov–Dec 2017). "We Need Computers with Empathy". Technology Review. 120 (6). p. 8. Archived from the original on 7 July 2018. Retrieved 29 June 2019.

- Empty citation (help)

- James, William (1884). "What is Emotion". Mind. 9 (34): 188–205. doi:10.1093/mind/os-IX.34.188. Cited by Tao and Tan.

- "Affective Computing" MIT Technical Report #321 (Abstract), 1995

- Kleine-Cosack, Christian (October 2006). "Recognition and Simulation of Emotions" (PDF). Archived from the original (PDF) on May 28, 2008. Retrieved May 13, 2008.

The introduction of emotion to computer science was done by Pickard (sic) who created the field of affective computing.

- Diamond, David (December 2003). "The Love Machine; Building computers that care". Wired. Archived from the original on 18 May 2008. Retrieved May 13, 2008.

Rosalind Picard, a genial MIT professor, is the field's godmother; her 1997 book, Affective Computing, triggered an explosion of interest in the emotional side of computers and their users.

- Garay, Nestor; Idoia Cearreta; Juan Miguel López; Inmaculada Fajardo (April 2006). "Assistive Technology and Affective Mediation" (PDF). Human Technology. 2 (1): 55–83. doi:10.17011/ht/urn.2006159. Archived (PDF) from the original on 28 May 2008. Retrieved 2008-05-12.

- Heise, David (2004). "Enculturating agents with expressive role behavior". In Sabine Payr; Trappl, Robert. Agent Culture: Human-Agent Interaction in a Mutlicultural World. Lawrence Erlbaum Associates. pp. 127–142.

- Restak, Richard (2006-12-17). "Mind Over Matter". The Washington Post. Retrieved 2008-05-13.

- Aleix, and Shichuan Du, Martinez (2012). "A model of the perception of facial expressions of emotion by humans: Research overview and perspectives". The Journal of Machine Learning Research. 13 (1): 1589–1608.

- Breazeal, C. and Aryananda, L. Recognition of affective communicative intent in robot-directed speech. Autonomous Robots 12 1, 2002. pp. 83–104.

- Dellaert, F. , Polizin, t. , and Waibel, A. , Recognizing Emotion in Speech", In Proc. Of ICSLP 1996, Philadelphia, PA, pp.1970-1973, 1996

- Roy, D.; Pentland, A. (1996-10-01). Automatic spoken affect classification and analysis. Proceedings of the Second International Conference on Automatic Face and Gesture Recognition. pp. 363–367. doi:10.1109/AFGR.1996.557292. ISBN 978-0-8186-7713-7.

- Lee, C.M. ; Narayanan, S. ; Pieraccini, R. , Recognition of Negative Emotion in the Human Speech Signals, Workshop on Auto. Speech Recognition and Understanding, Dec 2001

- Neiberg, D; Elenius, K; Laskowski, K (2006). "Emotion recognition in spontaneous speech using GMMs" (PDF). Proceedings of Interspeech.

- Yacoub, Sherif; Simske, Steve; Lin, Xiaofan; Burns, John (2003). "Recognition of Emotions in Interactive Voice Response Systems". Proceedings of Eurospeech: 729–732. CiteSeerX 10.1.1.420.8158.

- Hudlicka 2003

- Charles Osgood; William May; Murray Miron (1975). Cross-Cultural Universals of Affective Meaning. Univ. of Illinois Press. ISBN 978-94-007-5069-2.

- Scherer 2010

- "Gaussian Mixture Model". Connexions – Sharing Knowledge and Building Communities. Retrieved 10 March 2011.

- S.E. Khoruzhnikov; et al. (2014). "Extended speech emotion recognition and prediction". Scientific and Technical Journal of Information Technologies, Mechanics and Optics. 14 (6): 137.

- Ekman, P. & Friesen, W. V (1969). The repertoire of nonverbal behavior: Categories, origins, usage, and coding. Semiotica, 1, 49–98.

- Steidl, Stefan (5 March 2011). "FAU Aibo Emotion Corpus". Pattern Recognition Lab.

- Balomenos, T.; Raouzaiou, A.; Ioannou, S.; Drosopoulos, A.; Karpouzis, K.; Kollias, S. (2004). "Emotion Analysis in Man-Machine Interaction Systems". In Bengio, Samy; Bourlard, Herve. Machine Learning for Multimodal Interaction. Lecture Notes in Computer Science. 3361. Springer-Verlag. pp. 318–328.

- Ekman, Paul (1999). "Basic Emotions". In Dalgleish, T; Power, M. Handbook of Cognition and Emotion (PDF). Sussex, UK: John Wiley & Sons. Archived from the original (PDF) on 2010-12-28..

- "Facial Action Coding System (FACS) and the FACS Manual" بایگانیشده در اکتبر ۱۹, ۲۰۱۳ توسط Wayback Machine. A Human Face. Retrieved 21 March 2011.

- "Spatial domain methods".

- Clever Algorithms. "Bacterial Foraging Optimization Algorithm – Swarm Algorithms – Clever Algorithms" بایگانیشده در ۱۲ ژوئن ۲۰۱۹ توسط Wayback Machine. Clever Algorithms. Retrieved 21 March 2011.

- "Soft Computing". Soft Computing. Retrieved 18 March 2011.

- Nagpal, Renu, Pooja Nagpal, and Sumeet Kaur (2010). "Hybrid Technique for Human Face Emotion Detection" (PDF). International Journal of Advanced Computer Science and Applications. 1 (6): 91–101. doi:10.14569/IJACSA.2010.010615. Retrieved 11 March 2011.

- Williams, Mark. "Better Face-Recognition Software – Technology Review". Technology Review: The Authority on the Future of Technology. Retrieved 21 March 2011.

- J. K. Aggarwal, Q. Cai, Human Motion Analysis: A Review, Computer Vision and Image Understanding, Vol. 73, No. 3, 1999

- Pavlovic, Vladimir I.; Sharma, Rajeev; Huang, Thomas S. (1997). "Visual Interpretation of Hand Gestures for Human-Computer Interaction: A Review" (PDF). IEEE Transactions on Pattern Analysis and Machine Intelligence. 19 (7): 677–695. doi:10.1109/34.598226.

- Picard, Rosalind (1998). Affective Computing. MIT.

- Larsen JT, Norris CJ, Cacioppo JT, "Effects of positive and negative affect on electromyographic activity over zygomaticus major and corrugator supercilii", (September 2003)

- Ritendra Datta, Dhiraj Joshi, Jia Li and James Z. Wang, Studying Aesthetics in Photographic Images Using a Computational Approach, Lecture Notes in Computer Science, vol. 3953, Proceedings of the European Conference on Computer Vision, Part III, pp. 288-301, Graz, Austria, May 2006.

- «AutoTutor». بایگانیشده از اصلی در ۱۶ مه ۲۰۱۴. دریافتشده در ۲۹ ژوئن ۲۰۱۹.

- S. Asteriadis, P. Tzouveli, K. Karpouzis, S. Kollias (2009). "Estimation of behavioral user state based on eye gaze and head pose—application in an e-learning environment". Multimedia Tools and Applications. 41: 469–493. doi:10.1007/s11042-008-0240-1.

- Yonck, Richard (2017). Heart of the Machine: Our Future in a World of Artificial Emotional Intelligence. New York: Arcade Publishing. pp. 150–153. ISBN 978-1-62872-733-3. OCLC 956349457.

- Projects in Affective Computing

- Shanahan, James; Qu, Yan; Wiebe, Janyce (2006). Computing Attitude and Affect in Text: Theory and Applications. Dordrecht: Springer Science & Business Media. p. 94. شابک ۱۴۰۲۰۴۰۲۶۱

- Nijholt, Anton; Plass-Oude Bos, Danny; Reuderink, Boris (2009). "Turning shortcomings into challenges: Brain–computer interfaces for games". Entertainment Computing. 1 (2): 85–94. doi:10.1016/j.entcom.2009.09.007.

- Khandaker, M (2009). "Designing affective video games to support the social-emotional development of teenagers with autism spectrum disorders". Studies in Health Technology and Informatics. 144: 37–9. PMID 19592726.

- "In-Car Facial Recognition Detects Angry Drivers To Prevent Road Rage". Gizmodo. 30 August 2018.

- Janssen, Joris H.; van den Broek, Egon L. (July 2012). "Tune in to Your Emotions: A Robust Personalized Affective Music Player". User Modeling and User-Adapted Interaction. 22 (3): 255–279. doi:10.1007/s11257-011-9107-7.

- "Mona Lisa: Smiling? Computer Scientists Develop Software That Evaluates Facial Expressions". ScienceDaily. 1 August 2006. Archived from the original on 19 October 2007.

- Battarbee, Katja; Koskinen, Ilpo (2005). "Co-experience: user experience as interaction" (PDF). CoDesign. 1 (1): 5–18. CiteSeerX 10.1.1.294.9178. doi:10.1080/15710880412331289917.

- Boehner, Kirsten; DePaula, Rogerio; Dourish, Paul; Sengers, Phoebe (2007). "How emotion is made and measured". International Journal of Human-Computer Studies. 65 (4): 275–291. doi:10.1016/j.ijhcs.2006.11.016.

- Boehner, Kirsten; DePaula, Rogerio; Dourish, Paul; Sengers, Phoebe (2005). "Affection: From Information to Interaction". Proceedings of the Aarhus Decennial Conference on Critical Computing: 59–68.

- Hook, Kristina; Staahl, Anna; Sundstrom, Petra; Laaksolahti, Jarmo (2008). "Interactional empowerment" (PDF). Proc. CHI: 647–656.

منابع

- Hudlicka, Eva (2003). "To feel or not to feel: The role of affect in human-computer interaction". International Journal of Human-Computer Studies. 59 (1–2): 1–32. CiteSeerX 10.1.1.180.6429. doi:10.1016/s1071-5819(03)00047-8.

- Scherer, Klaus R; Banziger, T; Roesch, Etienne B (2010). A blueprint for affective computing: a sourcebook. Oxford: Oxford University Press.

پیوند به بیرون

- گروه تحقیق محاسباتی مؤثر در آزمایشگاه رسانه MIT

- گروه احساسی محاسباتی در USC

- گروه محاسبات هوشمند در دانشگاه ممفیس

- 2011 کنفرانس بینالمللی محاسبات مؤثر و تعامل هوشمند

- مغز، بدن و بایت: تعامل کاربر روانشناسی و روانشناختی کارگاه آموزشی CHI 2010 (10 تا ۱۵ آوریل ۲۰۱۰)

- مجله بینالمللی ایمنی مصنوعی

- معاملات IEEE در محاسبات مؤثر (TAC)

- Renu Nagpal, Pooja Nagpal و Sumeet Kaur، «تکنیک هیبرید برای تشخیص احساسات صورت انسان» مجله بینالمللی علوم کامپیوتر و برنامههای کاربردی (IJACSA)، 1 (6)، ۲۰۱۰

- openSMILE: ابزار محبوب Open-Source برای پیشرفتهترین ابزار برای بازشناسی تأثیر و زبانشناسی کامپیوتری