قضیه گوس-مارکوف

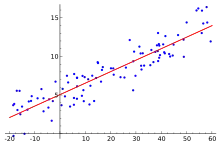

در علم آمار، قضیه گوس-مارکف (به انگلیسی: Gauss–Markov theorem) بیان میکند که در یک مدل خطی که خطاهای آن امید ریاضی صفر داشته، ناهمبسته بوده، و واریانسهای مساوی دارند، بهترین برآوردگر خطی نااریب برای ضرایب سیستم برابر برآوردگر کمترین مربعات میباشد.[1][2] شرح مدل خطی به صورت دقیقتر اینگونهاست که

| بخشی از مجموعه مباحث دربارهٔ آمار |

| تحلیل رگرسیون |

|---|

|

| مدلها |

|

|

|

|

| تخمین |

|

|

|

|

| پیشزمینه |

|

|

بطوری که ماتریس مدل بوده که معلوم و ثابت است، برداری نامعلوم با ابعاد در فضای است. بردار نیز بردار خطا میباشد.[1] در اینجا بهترین به معنای آن است که برآوردگر مورد نظر کمترین واریانس را در مقایسه با سایر برآوردگرهای خطی، داشته باشد. لازم نیست جملههای خطا توزیع طبیعی داشته باشند یا توزیع مستقل و یکسان داشته باشند و فرض ضروری ناهمبسته بودن و واریانس همسانی جملههای خطا میباشد. این قضیه به افتخار کارل فریدریش گاوس و آندری مارکوف نامگذاری شدهاست.

صورت قضیه

تساوی زیر را که به شکل ماتریسی نوشته شدهاست، در نظر بگیرید:

که فرم باز شدهٔ آن به شکل زیر در میآید:

در اینجا پارامترهای غیر تصادفی و غیرقابل مشاهده میباشند، متغیرهای توضیحی خوانده میشوند که غیرتصادفی و قابل مشاهده میباشند، و تصادفی میباشند. متغیرهای تصادفی «خطا» یا «اغتشاش» نامیده میشوند و باید بین آنها و جملههای باقیمانده تمایز قائل شد. توجه کنید معمولاً با معرفی متغیر در مدل رگرسیون خطی، جملهٔ ثابت را به مدل اضافه میکنند. قضیهٔ گاوس-مارکوف سه فرض اساسی در مورد متغیرهای تصادفی دارد:

- همهٔ آنها دارای میانگین صفر میباشند:

- جملههای خطا، واریانس همسانی دارند بدین معنی که واریانس آنها محدود است:

- جملههای خطای متمایز ناهمبسته میباشند:

برآوردگر خطی یک ترکیب خطی به شکل زیر میباشد:

ضرایب در معادلهٔ بالا مستقل از ضرایب میباشند زیرا همانطور که گفته شد قابل مشاهده نیستند ولی میتوانند تابعی از مقادیر باشند زیرا این دادهها قابل مشاهده میباشند. یک برآوردگر، نااریب میباشد اگر و تنها اگر

عبارت را که یک ترکیب خطی از ضرایب میباشد، در نظر بگیرید، میانگین مربعات خطا به شکل زیر تعریف میشود:

توجه کنید چون در اینجا برآوردگر تمام پارامترها نااریب میباشند در نتیجه عبارت بالا معادل واریانس ترکیب خطی مذکور میباشد. بهترین برآوردگر خطی نااریب بردار پارامترهای بدین معناست که ترکیب خطی پارامترها به ازای هر بردار ، دارای کمترین میانگین مربعات خطا میباشد. این شرط معادل این است که عبارت زیر یک ماتریس مثبت نیمه معین باشد:

که در آن یک برآوردگر خطی نااریب میباشد. برآوردگر حداقل مربعات معمولی تابعی از ، و (ترانهادهٔ ماتریس ) به فرم زیر میباشد:

ایدهٔ اصلی اثبات این است که برآوردگر حداقل مربعات معمولی با هر برآوردگر خطی نااریب دیگر ناهمسبته میباشد. در ادامه به اثبات قضیه میپردازیم.

اثبات[3]

به عنوان برآوردگر خطی در نظر بگیرید، ماتریس را میتوان اینگونه نوشت، که در آن یک ماتریس و غیر صفر میباشد. در ادامهٔ اثبات نشان میدهیم واریانس این برآوردگر نمیتواند کمتر از واریانس برآوردگر حداقل مربعات معمولی باشد.

شرط نااریب بودن برآوردگر بالا تنها در صورتی برقرار است که باشد؛ بنابراین:

چون یک ماتریس مثبت نیمه معین میباشد بنابراین نمیتواند کمتر از باشد و اثبات کامل میشود.

جستارهای وابسته

پانویس

- Hinkelmann, Klaus (1994), Design and Analysis of Experiments: Introduction to experimental design, به کوشش Klaus Hinkelmann, Oscar Kempthorne. Oscar Kempthorne, John Wiley and Sons, p. p. 117, ISBN 0-471-55178-3

- Hastie, Trevor (2007), The Elements of Statistical Learning: Data Mining, Inference, and Prediction, Jerome Friedman, Robert Tibshirani, Springer, p. p. 49, ISBN 0-387-95284-5

- Davidson, Russell، Mackinnon, David (۲۰۰۴). Econometric Theory And Methods. Canada: Oxford University Press. شابک ۰۱۹۵۱۲۳۷۲۷, ۹۷۸۰۱۹۵۱۲۳۷۲۲ مقدار

|شابک=را بررسی کنید: invalid character (کمک).

- Davison, Russell, MacKinnon, David. Econometric Theory And Methods Canada: Oxford university press, 2004.

- ویکیپدیای انگلیسی

- http://qed.econ.queensu.ca/ETM/data/