تحلیل دادهها

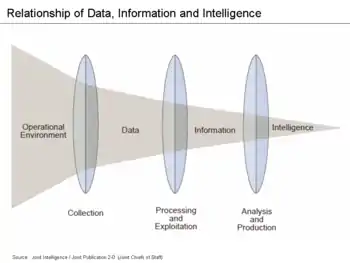

تحلیل داده (به انگلیسی: Data analysis) فرایند فهمیدن، پاکسازی، آمادهسازی و تحلیل دادههاست که به منظور استخراج اطلاعات سودمند برای تصمیمگیری انجام میشود. تحلیل دادهها امروزه در اغلب شاخههای علوم و صنعت از جمله اقتصاد، رشتههای مهندسی، بازاریابی، پزشکی و غیره کاربرد دارد.

داده کاوی، روش خاصی برای تحلیل داده است که بر مدلسازی و کشف دانش برای اهداف قابل پیشبینی و نه صرفاً توصیفی متمرکز است؛ در حالیکه هوش کسبوکار را پوشش میدهد که بهطور عمده بر تجمع اطلاعات کسبوکار متکی است.[1] در کاربردهای آماری، تجزیهوتحلیل دادهها را میتوان به آمار توصیفی، تجزیهوتحلیل دادههای اکتشافی (EDA) و تجزیهوتحلیل دادههای تأییدی (CDA) تقسیم کرد. EDA بر کشف ویژگیهای جدید در دادهها و CDA بر تأیید یا تکذیب فرضیههای موجود تمرکز دارد. علم تجزیهوتحلیل بر کاربرد مدلهای آماری برای پیشبینی یا طبقهبندی تمرکز دارد، در حالیکه تجزیهوتحلیل متن روشهای آماری، زبانی و ساختاری را برای استخراج و طبقهبندی اطلاعات از منابع متنی بهکار میبندد. تمام اینها، انواع تحلیل داده بهشمار میآیند.

یکپارچهسازی دادهها پیش زمینهای برای تحلیل دادهها است و تحلیل داده با مصورسازی داده و انتشار داده رابطه نزدیکی دارد. واژه تحلیل داده گاهی اوقات به عنوان مترادف برای مدلسازی داده استفاده میشود.

مراحل تحلیل داده

تجزیهوتحلیل به معنای شکستن کل به اجزاء جداگانه است. تحلیل داده روند به دست آوردن دادهٔ جدید و تبدیل آن به اطلاعاتی مفید در جهت تصمیمگیری کاربران است. داده جمعآوری و تحلیل میشود تا پاسخگوی سوالات، آزمایش فرضیهها یا تکذیب نظریهها باشد.[2]

آمارگر جان توکی در سال ۱۹۶۱ تحلیل دادهها را به صورت زیر تعریف کرد: «روشهایی برای تجزیهوتحلیل دادهها، تکنیکهایی برای تفسیر کردن نتایج حاصل از چنین روشهایی، روشهای برنامهریزی جمعآوری دادهها برای آسانتر ساختن تجزیهوتحلیل دقیقتر و صحیحتر و تمام ماشینآلات و نتایج حاصل از آمار که برای تحلیل کردن دادهها به کار بسته میشود.»[3]

چندین مرحله قابل تشخیص وجود دارد که در زیر توضیح داده میشود.[4]

الزامات داده

دادهٔ لازم به عنوان ورودی جهت تحلیل، بر اساس پیشنیازهای جهتدار یا مشتریانی که از محصول نهایی تحلیل استفاده میکنند، مشخص شدهاند. ماهیت کلی که بر مبنای آن داده جمعآوری خواهد شد، واحد آزمایشی نامیده میشود (بهطور مثال، یک فرد یا جمعیت). متغیرهای خاص در رابطه با یک جمعیت (بهطور مثال سن یا درآمد) میتواند مشخص شود و به دست آید. دادهها ممکن است عددی یا مطلق (مثلاً اعداد یا یک متن) باشند.[4]

جمعآوری داده

داده از منابع گوناگون جمعآوری میشود. پیشنیازها میتواند توسط تحلیلگران و متولیان داده وسیله ارتباطی باشد. مثلاً تجهیزات فناوری اطلاعات که در یک سازمان است. همچنین داده میتواند از سنسورهای داخل محیط مانند دوربینهای ترافیک، ماهواره، وسایل ثبت و غیره جمعآوری شود. همچنین میتواند از طریق مصاحبهها، دانلود از منابع آنلاین یا خواندن اسناد به دست آید.[4]

پردازش داده

داده اولیه باید برای تحلیل، فرآوری یا سازماندهی شود. بهطور مثال آنها در فرمت ستونی یا ردیفی در یک جدول قرار میگیرند (یعنی داده ساختاری) که برای تحلیل بیشتر از نرمافزارهای آماری یا صفحه گسترده استفاده میکنند.

پاکسازی داده

زمانی که سازماندهی انجام شد، داده ممکن است ناقص، دارای تکرار یا خطا باشد. نیاز به پاکسازی داده هنگام وقوع مشکل در مسیر ورود یا ذخیرهٔ داده معلوم میشود. پاکسازی داده فرایندی برای اصلاح یا جلوگیری از چنین خطاهایی است. اهداف رایج شامل ثبت تطابق، شناسایی عدم دقت داده، کیفیت کلی دادهٔ موجود،[5] حذف دادههای تکراری و تقسیمبندی ستون است.[6] چنین مشکلاتی در داده از طریق روشهای مختلف تحلیلی هم میتواند قابل تشخیص باشد. بهطور مثال با اطلاعات مالی، مجموع متغیرهای مشخص ممکن است با اعدادی که جداگانه به عنوان داده مورد قبول منتشر شده بودند، مقایسه شود.[7] مقادیر غیرعادی بالا یا زیر آستانهٔ مشخص هم باید دوباره بررسی شود. بسته به نوع داده مانند شمارههای تماس، آدرسهای ایمیل، کارمندان و غیره انواع پاکسازی داده وجود دارد. روشهای دادهٔ کمی برای تشخیص دادههای پرت میتواند برای خارج کردن دادههایی که اشتباهاً وارد شده هم استفاده شود. بررسیکنندههای غلط املایی میتواند برای کاهش مقدار کلمات اشتباه تایپ شده به کار رود اما مشکل اینجاست که کلماتی که خودشان درستاند تشخیص داده شود.[8]

تجزیهوتحلیل داده اکتشافی

زمانی که داده پاکسازی شد، میتواند تحلیل شود. برای داده اکتشافی، تحلیلگر ممکن است چندین روش را به کار ببندد تا پیام موجود در داده را بتواند درک کند. خود این بخش میتواند شامل پاکسازی دیگری شود.[9][10] بنابراین این فعالیتها در ذات خود ممکن است تکرار داشته باشند. آمار توصیفی مانند معدل و میانه ممکن است برای کمک به فهم آن داده تولید شود. مصورسازی داده نیز به فرمت گرافیکی به کار میرود تا دید بیشتری نسبت به پیامهای درون داده حاصل آید.[4]

مدلسازی و الگوریتم

مدلها یا فرمولهای ریاضی که به آنها الگوریتم گفته میشود، ممکن است بر روی داده به کار بسته شود تا روابط بین متغیرها مانند همبستگی یا نسبت میان علت و معمول شناسایی شود. بهطور کلی، مدلها برای ارزیابی به متغیری مشخص در داده که بر مبنای دیگر متغیرها است، توسعه مییابد که در آن چند خطای باقیمانده بسته به دقت مدل وجود دارد (داد ه= مدل + خطا).

آمار استنتاجی، شامل روشهای اندازهگیری روابط بین متغیرهای مشخص میباشد. برای مثال، تحلیل رگرسیون ممکن است برای مدل استفاده شود که تغییر در تبلیغ (متغیر مستقل X) و تغییر در فروش (متغیر وابسته Y) را توضیح میدهد. از لحاظ ریاضی، Y (فروش) تابعی از X (تبلیغات) است. ممکن است به صورت Y = aX + b + error توضیح داده شود که در آن مدل به گونهای طراحی شده که a و b زمانی که مدل Y را برای طیفی از مقادیر X پیشبینی میکند، خطا را کاهش دهند. ممکن است تحلیلگران سعی کنند تا مدلهایی بسازند که توصیفی هستند تا تحلیل ساده و نتایج قابل فهم شود.

محصول داده

محصول داده یک برنامه کامپیوتری است که دادهها را گرفته و خروجی تولید میکند و آنها را به محیط برمیگرداند؛ میتواند برحسب یک مدل یا الگوریتم باشد. برای مثال، برنامهای کاربردی که اطلاعات تاریخچه خرید مشتری را تحلیل میکند و خریدهایی که ممکن است برای آن مشتری مطلوب باشد را پیشنهاد میکند.[4]

ارتباط

مقاله اصلی: مصورسازی داده

هنگامی که دادهها مورد تجزیه و تحلیل است، میتواند به فرمتهای مختلف برای کاربران گزارش شود تا نیازهای آنها حمایت شود. کاربران ممکن است بازخورد دهند که موجب تجزیه و تحلیل اضافی میشود. به این ترتیب، بسیاری از چرخه تحلیلی تکراری است.[4]

هنگام تعیین نحوه انتقال نتایج، تحلیلگر ممکن است که روشهای تجسم داده را برای کمک به شفافیت و کارایی در انتقال پیام به مخاطب در نظر بگیرد. تجسم داده اطلاعات را به صورت جدولها و نمودارها نمایش میدهد تا پیام کلیدی موجود در داده قابل انتقال شود. جدولها برای کاربری که به دنبال اعداد خاصی است کمککننده است در حالی که نمودارها (مثلاً نمودار خطی یا نمودار میلهای) برای توضیح پیامهای کمی کمککننده هستند.

روشهای تجزیهوتحلیل دادهٔ کمی

همچنین ببینید: حل مسئله

نویسنده جاناتان کومی چند سری از بهترین تمرینها را برای فهم بهتر دادهٔ کمی توصیه میکند که عبارتند از:

- دادهٔ خام را قبل از اجرای تحلیلتان بررسی کنید؛

- محاسبات مهم، مانند بررسی ستون داده که از فرمول به دست آمده را مجدداً اجرا کنید؛

- کلیات را که حاصل زیرمجموعهها هستند، تأیید کنید؛

- روابط بین اعدادی را که میبایست مربوط به حالتی قابل پیشبینی باشند، مانند نرخها در طول زمان، چک کنید؛

- به منظور سادهسازی مقایسه، بخشهایی چون تحلیل مقادیر را در هر نفر یا نسبت به تولید ناخالصی داخلی (GDP) یا به عنوان شاخص نسبی در یک سال پایه را به صورت قاعده درآورید؛

- مشکلات را به عوامل تحلیلی که منجر به نتیجه میشوند، بشکنید.

برای متغیرهای تحت بررسی، تحلیلگران معمولاً آمار توصیفی به دست میآورند (مانند معدل، میانه و انحراف معیار). آنها همچنین ممکن است که توزیع متغیرهای کلیدی را تحلیل کنند تا چگونگی مقادیر مشخص حول میانه را ببینند.

مشاوران در مکنزی اند کامپنی، روش شکستن مشکلات کمی به اجزاء آن را اصل MECE نامگذاری کردند. هر لایه میتواند به اجزایش شکسته شود. هر جزء باید منحصر به دیگری باشد و به صورت تجمعی به لایه بالاییاش اضافه شود. این رابطه به نام «متقابلاً منحصر به فرد و تجمعی کامل» یا MECE خوانده میشود. بهطور مثال، سود طبق تعریف میتواند به درآمد کل و هزینه کل شکسته شود. به نوبه خود، درآمد کل میتواند توسط اجزای آن تحلیل شود؛ از جمله درآمد حاصل از بخش B, A و C (متقابلاً منحصر به فرداند) که باید به درآمد کل (تجمعی کامل) اضافه شوند.

تحلیلگران ممکن است اندازهگیریهای آماری قوی برای حل مشکلات تحلیلی خاص به کار ببرند. آزمون فرضیه زمانی استفاده میشود که فرضیه خاصی دربارهٔ حالت واقعی امور توسط تحلیلگر ساخته میشود و داده برای تعیین اینکه آیا آن حالت درست است یا غلط، به کار میرود. برای مثال، ممکن است فرضیه این باشد که «بیکاران اثری بر تورم ندارند» که مربوط به مفهومی اقتصادی است. آزمون فرضیه شامل در نظر گرفتن احتمال نوع I و نوع II است و مرتبط است به اینکه آیا داده فرضیه را رد میکند یا میپذیرد.

تحلیل رگرسیون زمانی به کار میرود که تحلیلگر سعی دارد تعیین کند که تا چه میزان متغیرهای مستقل X بر متغیرهای وابسته Y تأثیر میگذارند (مثلاً تا چه حد تغییرات نرخ بیکاری X در نرخ تورم Y تأثیر دارد؟). این تلاشی برای مدلسازی یا برقراری خط تساوی یا منحنی داده در تابع Y به X است.

تحلیل شرطی لازم (NCA) در حالتی بهکار میرود که تحلیلگر سعی دارد تعیین کند که تا چه میزان متغیر مستقل X, متغیر Y را میپذیرد (بهطور مثال، تا چه میزان نرخ مشخصی از بیکاری (X) برای نرخ تورم (Y) ضروری است). درحالیکه تحلیل (چند) رگرسیونی منطق افزایشی دارد که در آن هر متغیر X میتواند نتیجهای تولید کند و Xها برای یکدیگر جبران میکنند (کافی هستند ولی غیر ضروری) و تحلیل شرطی لازم (NCA) منطق ضرورت را بهکار میبرد که در آن ممکن است یک یا چند متغیر X نتیجه را بپذیرد ولی شاید موجب تولید آن نباشد (ضروری هستند ولی کافی نیستند). هر شرط لازم باید وجود داشته باشد و جبران خسارت امکانپذیر نیست.

جستارهای وابسته

منابع

- «Exploring Data Analysis». بایگانیشده از اصلی در 18 اكتبر 2017. دریافتشده در 18 ژوئن 2017. تاریخ وارد شده در

|archive-date=را بررسی کنید (کمک) - Judd, Charles and, McCleland, Gary (1989). Data Analysis. Harcourt Brace Jovanovich. ISBN 0-15-516765-0.

- John Tukey-The Future of Data Analysis-July 1961

- O'Neil, Cathy and, Schutt, Rachel (2014). Doing Data Science. O'Reilly. ISBN 978-1-4493-5865-5.

- Clean Data in CRM: The Key to Generate Sales-Ready Leads and Boost Your Revenue Pool Retrieved 29th July, 2016

- "Data Cleaning". Microsoft Research. Retrieved 26 October 2013.

- Perceptual Edge-Jonathan Koomey-Best practices for understanding quantitative data-February 14, 2006

- Hellerstein, Joseph (27 February 2008). "Quantitative Data Cleaning for Large Databases" (PDF). EECS Computer Science Division: 3. Retrieved 26 October 2013.

- Stephen Few-Perceptual Edge-Selecting the Right Graph For Your Message-September 2004

- «Behrens-Principles and Procedures of Exploratory Data Analysis-American Psychological Association-1997» (PDF). بایگانیشده از اصلی (PDF) در ۱۷ ژوئن ۲۰۱۵. دریافتشده در ۱۸ ژوئن ۲۰۱۷.

Provost, F. , & Fawcett, T. (2013). Data Science for Business: What you need to know about data mining and data-analytic thinking. " O'Reilly Media, Inc.".